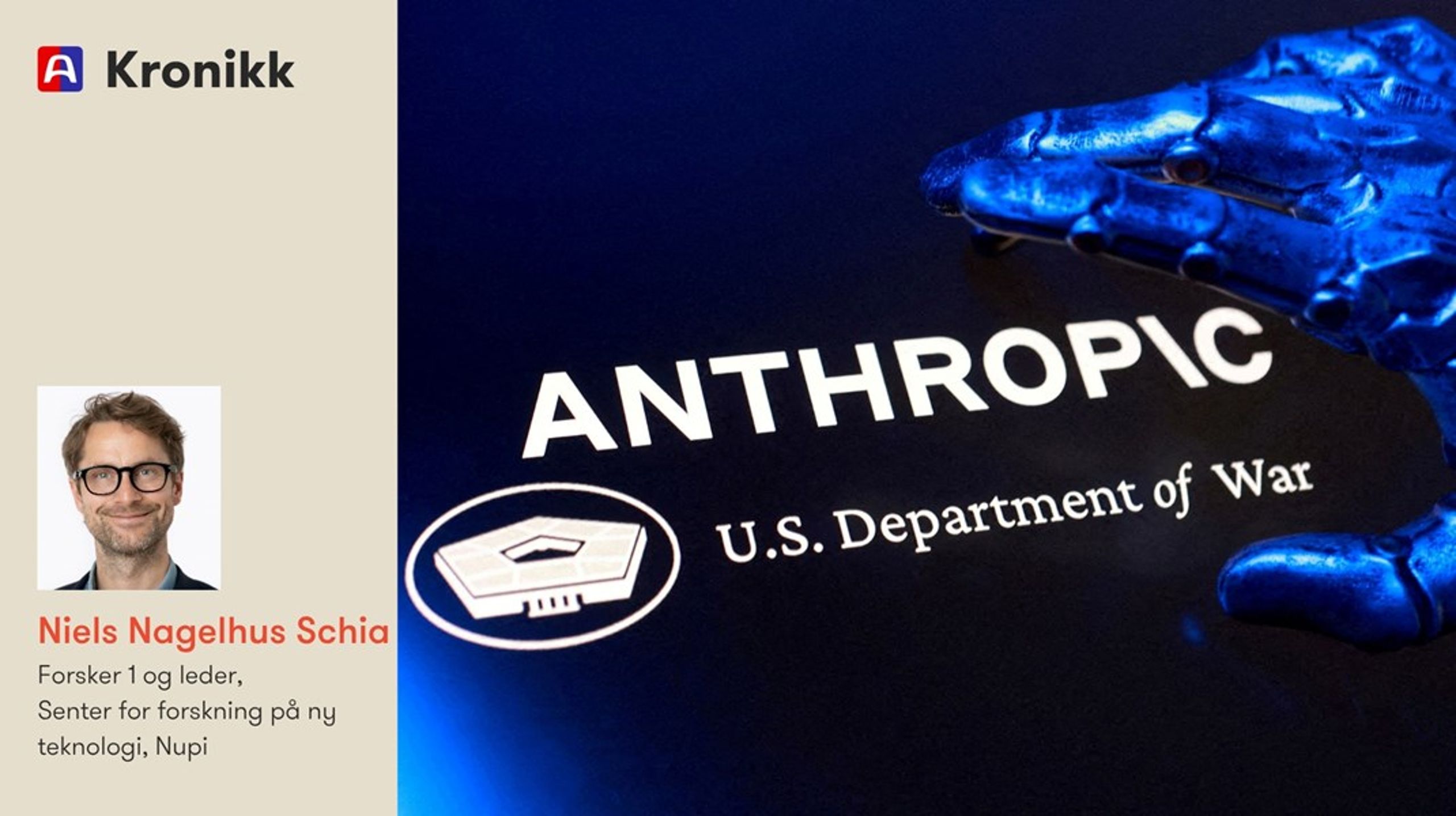

Hvem skal kontrollere bruken av kunstig intelligens?

En konflikt mellom et teknologiselskap og det amerikanske forsvarsdepartementet kan ved første øyekast fremstå som en smal juridisk strid. Men saken mellom Anthropic og Pentagon peker langt utover seg selv. Den handler om noe mer grunnleggende, nemlig hvem som skal kontrollere bruken av kunstig intelligens i krig.

Dette er ikke bare en konflikt om kontrakter, men om makt, ansvar og styring i en ny teknologisk virkelighet.

Et brudd med en etablert orden

Historisk har staten hatt kontroll over militær teknologi. Når myndigheter kjøper våpen eller avanserte systemer, følger det en implisitt forventning om at teknologien skal kunne brukes til alle lovlige militære formål. Leverandøren leverer og staten bestemmer. Det er denne logikken som nå utfordres.

Nye KI-selskaper, som Anthropic, hevder at de ikke bare leverer teknologi. De hevder også retten til å sette grenser for hvordan teknologien brukes. Gjennom innebygde begrensninger, såkalte «guardrails», forsøker de å forhindre bruk til eksempelvis autonome våpen eller visse typer overvåkning. For selskapet er dette et helt sentralt spørsmål om ansvar og etikk.

Dermed oppstår et prinsipielt spørsmål: Kan et privat selskap nekte militæret å bruke teknologi det har kjøpt, eller har staten rett til full kontroll? Dette er ikke et teknisk spørsmål, men et spørsmål om makt, kontroll og suverenitet.

Når leverandøren blir en geopolitisk aktør

Konflikten synliggjør også en dypere endring i maktbalansen mellom stat og marked. Tidligere var det staten som drev frem de mest avanserte teknologiene som atomvåpen, romfart, og internett. I dag ligger fronten i private selskaper. De mest avanserte KI-modellene utvikles ikke i Pentagon, men i selskaper som Anthropic, OpenAI og Google DeepMind. Det gir disse selskapene en ny type makt.

Når et selskap kan si nei til militær bruk, påvirker det ikke bare en kontrakt, det kan også påvirke nasjonal sikkerhetspolitikk. Teknologiselskapene blir dermed ikke bare leverandører, men aktører med reell geopolitisk betydning. Dette er en ny situasjon. Og vi har ennå ikke utviklet institusjonene som kan håndtere den.

Pentagon og frykten for å miste kontroll

Fra Pentagons perspektiv er problemet ikke først og fremst etikk, men kontroll. Når forsvarsdepartementet omtaler Anthropic som en «verdikjederisiko», handler det ikke primært om cybersikkerhet. Det handler om forutsigbarhet og styring. Hva skjer hvis en KI-modell ikke svarer i en kritisk situasjon? Hva skjer hvis leverandøren endrer vilkår? Hva skjer hvis bruken begrenses i en operasjon?

Teknologiselskapene blir dermed ikke bare leverandører, men aktører med reell geopolitisk betydning.

Niels Nagelhus Schia

Forsker, Nupi

For militæret er dette ikke hypotetiske spørsmål. Det er spørsmål om operasjonell pålitelighet og risiko. En leverandør som setter egne normative grenser, oppfattes derfor ikke som nøytral, men som en potensiell begrensning i seg selv.

Samtidig ligger det også et mer klassisk problem her som handler om avhengigheter. Hvis militæret bygger systemer rundt én leverandør, og selskapet senere endrer tilgang, priser eller policyer, kan det skape strategisk avhengighet av en aktør. De risikerer på den måten å bli låst til en aktør som de ikke kontrollerer, en såkalt «lock-in»-situasjon. Dette ligner på hvordan man tidligere har vurdert risiko knyttet til utenlandske leverandører, og kritisk infrastruktur.

Noe nytt

Dette er ikke første gang Silicon Valley og Pentagon kolliderer. Da Google samarbeidet med Project Maven i 2018, protesterte tusenvis av ansatte mot bruk av KI i droneanalyse. Resultatet var at Google trakk seg.

Samtidig har selskaper som Palantir gått i motsatt retning og gjort seg til en tett partner for forsvarssektoren. OpenAI har gradvis åpnet for samarbeid, men med begrensninger. Forskjellen nå er at konflikten er blitt juridisk. Tidligere handlet det om interne protester og kontrakter. Nå kan domstolene bli nødt til å avgjøre hvor grensene går, og det er dette som gjør tvisten til en potensiell presedenssak.

Et symptom på et større geopolitisk skifte

At denne konflikten skjer nå, er ikke tilfeldig. Kunstig intelligens er blitt definert som en strategisk nøkkelteknologi i stormaktsrivaliseringen, særlig mellom USA og Kina. I Washington snakker man om risikoen for et nytt «Sputnik-øyeblikk», et scenario der USA faller bak teknologisk.

Samtidig er militæret blitt strukturelt avhengig av private selskaper for tilgang til den mest avanserte teknologien. Dette skaper en spenning mellom behov for kontroll og fleksibilitet fra staten på den ene siden, og ønsker om begrensninger og ansvar fra selskapene på den andre siden, ihvertfall noen av dem. Konflikten mellom Anthropic og Pentagon er et direkte uttrykk for denne spenningen.

Hvem setter grensene?

I dag finnes det ikke noe klart svar på hvem som skal sette grensene for militær bruk av kunstig intelligens, men det er tre muligheter som peker seg ut:

- Staten, gjennom lovgivning og kontrakter

- Teknologiselskapene, gjennom egne etiske rammer

- Internasjonale regler, som fortsatt er svakt utviklet

Anthropic-saken kan bli et tidlig testtilfelle. Hvis staten vinner frem, kan det etablere et prinsipp om full statlig kontroll over KI i militær sammenheng. Hvis selskapene får gjennomslag, kan det åpne for at private aktører setter reelle begrensninger på staters bruk av teknologi i krig. Begge utfall vil få konsekvenser langt utover USA.

Konflikten mellom Anthropic og Pentagon er ikke slutten på en debatt, men starten på en ny fase.

Niels Nagelhus Schia

Forsker, Nupi

Også en europeisk og norsk problemstilling

Det er fristende å se dette som en amerikansk debatt. Det er det ikke. Også europeiske land, inkludert Norge, vil i økende grad måtte forholde seg til de samme spørsmålene: Hvor mye kontroll kan og bør staten ha over KI-systemer levert av private aktører? Hvor går grensen mellom etisk ansvar og operasjonell evne? Og hva skjer når våre viktigste teknologier utvikles utenfor statlig kontroll?

Dette er spørsmål vi ennå ikke har begynt å besvare fullt ut.

En konflikt som bare så vidt har begynt

Konflikten mellom Anthropic og Pentagon er ikke slutten på en debatt, men starten på en ny fase, der forholdet mellom stat, teknologi og militærmakt må forhandles på nytt. Kunstig intelligens er i ferd med å bli en integrert del av samfunnets mest sentrale funksjoner. Samtidig er det uklart hvem som skal kontrollere teknologien, og etter hvilke prinsipper.

Konflikten mellom Anthropic og Pentagon synliggjør dette mer grunnleggende styringsproblemet.

Innsikt

Arild Hermstad spør Åsmund AukrustHvilke resultater oppnådde statsråden i samtalene med kinesiske myndigheter angående åpenhet i leverandørkjeder?Besvart

Arild Hermstad spør Åsmund AukrustHvilke resultater oppnådde statsråden i samtalene med kinesiske myndigheter angående åpenhet i leverandørkjeder?Besvart

Ida Lindtveit Røse spør Jan Christian VestreHvordan vurderer statsråden behovet for å stramme inn på pakkestørrelser for tobakk?Besvart

Ida Lindtveit Røse spør Jan Christian VestreHvordan vurderer statsråden behovet for å stramme inn på pakkestørrelser for tobakk?Besvart

Dagfinn Henrik Olsen spør Astri Aas-HansenEr det i tråd med forutsetningene for stillingen og hensynet til beredskap at HRS-direktøren i begrenset grad er til stede ved hovedkontoret i Bodø?Besvart

Dagfinn Henrik Olsen spør Astri Aas-HansenEr det i tråd med forutsetningene for stillingen og hensynet til beredskap at HRS-direktøren i begrenset grad er til stede ved hovedkontoret i Bodø?Besvart